L’intelligence artificielle (IA) a connu une croissance exponentielle ces dernières années, notamment avec le développement des Large Language Models (LLM) et des Agents AI. Ces technologies transforment le paysage numérique et influencent de nombreux secteurs. Mais quelle est la différence entre un LLM et un Agent AI ? Pourquoi ces technologies sont-elles si importantes ? Cette page propose une analyse détaillée de ces concepts, de leur fonctionnement, de leurs applications et de leurs différences fondamentales.

1. Qu'est-ce qu'un Large Language Model (LLM) ?

Définition

Un Large Language Model (LLM) est un modèle d’intelligence artificielle conçu pour comprendre, analyser et générer du langage naturel. Il repose sur une architecture avancée appelée transformers, qui permet de traiter des séquences de texte en capturant les relations contextuelles entre les mots. Ces modèles sont composés de millions, voire de milliards de paramètres ajustés grâce à des techniques d’apprentissage profond.

Architecture Transformers

Les Transformers fonctionnent grâce à plusieurs mécanismes clés :

- Mécanisme d’auto-attention (Self-Attention) : Permet au modèle d’examiner toutes les relations entre les mots d’une phrase, capturant ainsi le contexte global et améliorant la cohérence des réponses.

- Encodage des mots (Word Embeddings) : Chaque mot est transformé en une représentation vectorielle qui capture son sens et ses relations avec d’autres mots.

- Encodage de position (Positional Encoding) : Les Transformers n’analysant pas les phrases séquentiellement, ils utilisent des signaux positionnels pour conserver la notion d’ordre des mots.

- Traitement en parallèle : Contrairement aux architectures plus anciennes comme les RNN (Recurrent Neural Networks, ex : Siri, Google assistant)) et LSTM (Long Short-Term Memory, ex : prédiction de phrase, prévisions boursières), les Transformers peuvent traiter toutes les parties d’une phrase simultanément, rendant l’entraînement et l’inférence beaucoup plus rapides.

Les LLM sont formés sur d’immenses corpus de données textuelles provenant de livres, d’articles, de sites web et d’autres sources.

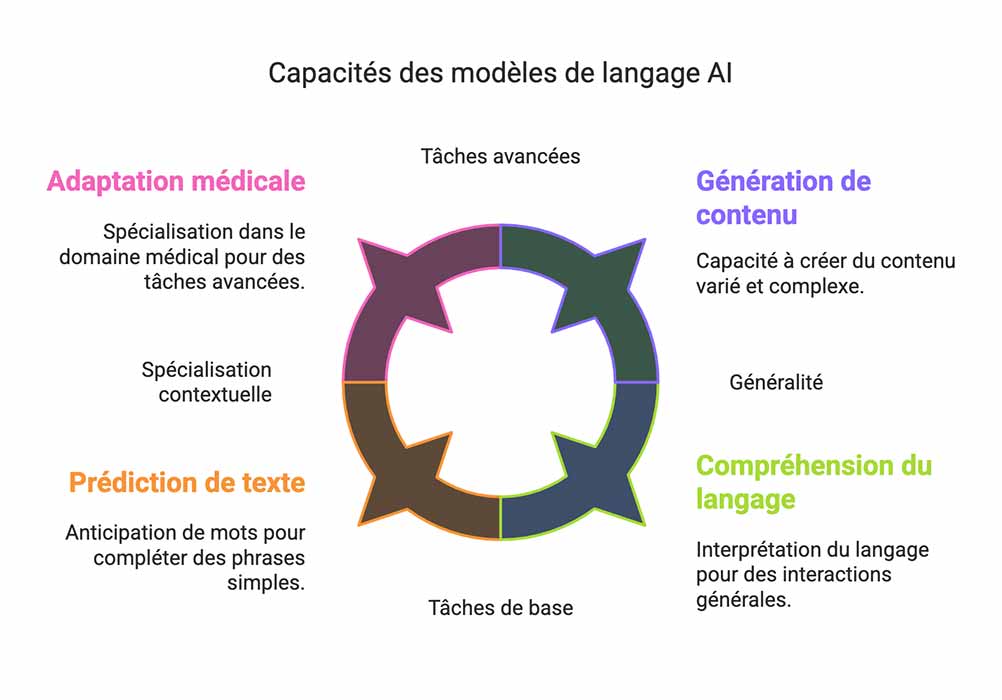

Ce vaste apprentissage leur permet d’exceller dans diverses tâches linguistiques telles que :

L’architecture des transformers, associée à des mécanismes d’attention, permet aux LLM de traiter et de contextualiser efficacement de grandes quantités d’informations, rendant ces modèles particulièrement performants pour la création et l’analyse de texte.

Comment choisir son LLM ?

Avec la multiplication des LLM, il est essentiel de choisir un modèle adapté à ses besoins spécifiques. Que ce soit pour la génération de contenu, l’analyse de texte ou la compréhension du langage naturel, voici quelques critères à prendre en compte :

- Définir l’objectif d’utilisation

- Création de contenu et rédaction automatique : Pour générer des articles, résumer des textes ou traduire.

- Analyse et compréhension de texte : Pour extraire des informations clés, répondre à des questions complexes.

- Programmation et automatisation : Pour générer du code, assister au développement logiciel et optimiser les workflows.

- Comparer les performances des modèles

- Certains LLM sont spécialisés dans la rapidité et l’efficacité énergétique, tandis que d’autres offrent une meilleure compréhension contextuelle et sémantique.

- Il est important de comparer les benchmarks et les performances sur des tâches spécifiques.

- Vérifier la disponibilité et l’accessibilité

- Certains modèles sont open-source et disponibles gratuitement, tandis que d’autres nécessitent une licence ou un abonnement.

- L’intégration avec des outils existants (APIs, services cloud) peut être un facteur déterminant.

- Accéder à un répertoire spécialisé

Pour explorer et comparer les LLM disponibles, consultez LLM Models, un répertoire regroupant les modèles les plus récents et performants ainsi que leurs spécifications détaillées.

Exemples de LLM

- Utilisé dans ChatGPT, ce modèle excelle en génération de texte et en compréhension du langage naturel.

- Applications : Chatbots, rédaction de contenu, programmation assistée

- Multimodal, il traite du texte, des images et du son

- Applications : Recherche avancée, analyse de données, moteur de recherche.

- Conçu avec une approche éthique et axé sur la transparence et la sécurité.

- Applications : Assistance IA fiable, résolutions de problèmes complexes.

- Open-source et performant, accessible aux chercheurs et développeurs.

- Applications : Recherche académique, développement IA personnalisé.

- Modèle compact mais puissant, optimisé pour l’efficacité.

- Applications : Assistance en entreprise, outils NLP embarqués.

Fonctionnement des LLM

Les Large Language Models (LLM) fonctionnent selon un processus complexe basé sur des millions voire des milliards de paramètres ajustés à partir de vastes ensembles de données.

Ce fonctionnement repose sur plusieurs étapes clés qui permettent à ces modèles d’acquérir des compétences avancées en traitement du langage naturel.

Grâce à ces étapes, les LLM peuvent comprendre et générer du texte avec une grande précision, s’adapter à différents contextes et répondre aux besoins spécifiques des utilisateurs.

- Collecte de données : Les LLM sont entraînés sur d’immenses volumes de textes issus de livres, articles et bases de données publiques.

- Pré-entraînement : Le modèle apprend à prédire les mots suivants en analysant les relations contextuelles entre les mots.

- Fine-tuning : Une fois le modèle pré-entraîné, il peut être affiné (fine-tuned) pour des tâches spécifiques. Cela consiste à lui faire apprendre à partir de données plus ciblées afin d’améliorer ses performances sur des domaines particuliers comme la médecine, le droit ou la programmation.

- Exemple : GPT-4 peut être ajusté pour mieux comprendre le vocabulaire juridique ou médical en étant exposé à des bases de données spécialisées.

- Avantage : Cela permet de rendre le modèle plus précis et performant dans des contextes spécifiques en réduisant les erreurs et en optimisant la pertinence des réponses.

Les applications du fine-tuning sont variées :

- Service client et chatbots : Amélioration de l’automatisation des réponses et de la personnalisation des interactions utilisateur.

- Génération et rédaction de contenu : Production de textes optimisés pour des secteurs spécifiques comme le journalisme ou la publicité.

- Programmation et développement : Assistance améliorée au codage, avec des suggestions plus précises et adaptées aux langages spécifiques.

- Recherche et analyse de données : Meilleure extraction d’informations et optimisation de la synthèse de documents scientifiques.

2. Qu'est-ce qu'un Agent AI ?

Définition

Un Large Language Model (LLM) est un modèle d’intelligence artificielle conçu pour comprendre, analyser et générer du langage naturel. Il repose sur une architecture avancée appelée transformers, qui permet de traiter des séquences de texte en capturant les relations contextuelles entre les mots. Ces modèles sont composés de millions, voire de milliards de paramètres ajustés grâce à des techniques d’apprentissage profond.

Fonctionnement

Les Agents AI fonctionnent grâce à un ensemble de technologies combinées :

- Traitement du langage naturel (NLP) : Compréhension et interprétation des instructions textuelles.

- Apprentissage automatique (Machine Learning) : Adaptation et amélioration continue des performances.

- Automatisation des processus robotiques (RPA) : Exécution de tâches automatisées en interaction avec des systèmes informatiques.

- Intégration avec des APIs et bases de données : Accès aux informations et déclenchement d’actions spécifiques.

- Prise de décision avancée : Évaluation de scénarios et sélection des actions les plus pertinentes.

Comment choisir son Agent AI ?

Avec la diversité croissante des Agents AI, il est essentiel de sélectionner celui qui correspond le mieux à vos besoins. Que ce soit pour automatiser des tâches, améliorer l’efficacité opérationnelle ou renforcer la cybersécurité, plusieurs critères doivent être pris en compte :

1. Définir son objectif

- Automatisation de processus métier : Pour optimiser la gestion d’entreprise et automatiser les tâches répétitives.

- Analyse et prise de décision : Pour exploiter des données complexes et générer des recommandations stratégiques.

- Sécurité et surveillance : Pour renforcer la cybersécurité et protéger les infrastructures numériques.

2. Vérifier la compatibilité

- L’Agent AI doit être compatible avec vos outils existants (logiciels, API, bases de données).

- Il doit être évolutif et s’adapter aux besoins futurs de votre organisation.

3. Évaluer la facilité d’intégration

- L’agent doit proposer une interface intuitive et une documentation claire.

- Il doit être facilement configurable pour s’intégrer à vos workflows existants.

4. Accéder à un répertoire spécialisé

Pour explorer et comparer les Agents AI disponibles, consultez AI Agents Directory, un répertoire dédié qui offre une vue d’ensemble des solutions actuelles et de leurs fonctionnalités.

Domaines d'application

Avec la diversité croissante des Agents AI, il est essentiel de sélectionner celui qui correspond le mieux à vos besoins.

Que ce soit pour automatiser des tâches, améliorer l’efficacité opérationnelle ou renforcer la cybersécurité, plusieurs critères doivent être pris en compte :

1. Définir son objectif

- Automatisation de processus métier : Pour optimiser la gestion d’entreprise et automatiser les tâches répétitives.

- Analyse et prise de décision : Pour exploiter des données complexes et générer des recommandations stratégiques.

- Sécurité et surveillance : Pour renforcer la cybersécurité et protéger les infrastructures numériques.

2. Vérifier la compatibilité

- L’Agent AI doit être compatible avec vos outils existants (logiciels, API, bases de données).

- Il doit être évolutif et s’adapter aux besoins futurs de votre organisation.

3. Évaluer la facilité d’intégration

- L’agent doit proposer une interface intuitive et une documentation claire.

- Il doit être facilement configurable pour s’intégrer à vos workflows existants.

4. Accéder à un répertoire spécialisé

Pour explorer et comparer les Agents AI disponibles, consultez AI Agents Directory, un répertoire dédié qui offre une vue d’ensemble des solutions actuelles et de leurs fonctionnalités.

3. Contraintes et défis des Agents AI

Malgré leur potentiel impressionnant, les Agents AI présentent plusieurs contraintes et défis qu’il est crucial de considérer :

1. Limitations techniques

- Manque d’adaptabilité totale : Bien que les Agents AI puissent exécuter des tâches spécifiques, ils peinent à généraliser leurs compétences au-delà de leur domaine d’apprentissage.

- Problèmes d’intégration : L’intégration avec des infrastructures existantes (ERP, systèmes cloud, APIs variées) peut être complexe et nécessiter des ajustements techniques importants.

- Consommation de ressources : Les agents AI nécessitent une puissance de calcul élevée et peuvent être gourmands en énergie, posant des défis en termes de coûts et d’optimisation.

2. Sécurité et fiabilité

- Biais algorithmiques : Comme les LLM, les Agents AI peuvent hériter de biais présents dans les données d’entraînement, ce qui peut mener à des décisions erronées.

- Vulnérabilités aux attaques : Les agents IA peuvent être exploités par des cyberattaques (manipulation des entrées, exfiltration de données, attaques adversariales).

- Erreurs dans la prise de décision : Un manque de supervision humaine peut entraîner des décisions inappropriées, notamment dans des domaines critiques comme la finance ou la cybersécurité.

3. Contraintes éthiques et légales

- Manque de transparence : Les décisions des Agents AI sont souvent des « boîtes noires », rendant difficile leur audit et leur justification.

- Problèmes de responsabilité : En cas d’erreur ou de dysfonctionnement, il est difficile d’attribuer une responsabilité claire entre le développeur, l’entreprise qui l’utilise et l’utilisateur final.

- Respect des réglementations : L’utilisation des Agents AI est soumise à des lois en constante évolution, comme le RGPD en Europe et l’AI Act.

4. Impact sur l’emploi et l’économie

- Automatisation excessive : La montée en puissance des Agents AI peut entraîner des pertes d’emplois, notamment dans les services clients et les tâches administratives répétitives.

- Nécessité de requalification : Les employés doivent s’adapter aux nouveaux outils et développer des compétences en gestion et supervision d’Agents AI.

4. Différences entre LLM et Agent AI

| Critères | LLM | Agent AI |

| Fonction | Comprendre et générer du texte | Prendre des décisions et exécuter des actions |

| Interaction | Répondre aux requêtes textuelles | Utiliser divers outils et sources de données |

| Autonomie | Limitée, dépend des requêtes | Peut agir seul avec des objectifs précis |

5. Conclusion et perspectives

Les LLM et les Agents AI sont deux technologies complémentaires. Tandis que les LLM sont idéaux pour la génération de texte et la compréhension du langage naturel, les Agents AI permettent une interaction plus avancée avec leur environnement.

Avec l’évolution de l’IA, nous verrons de plus en plus de combinaisons entre LLM et Agents AI, permettant de créer des systèmes encore plus intelligents et autonomes.

L’avenir de ces technologies est prometteur et leur impact sur les entreprises, la recherche et la société continue d’évoluer. Restez à l’affût des prochaines innovations !